무슨 일이 있었나요?

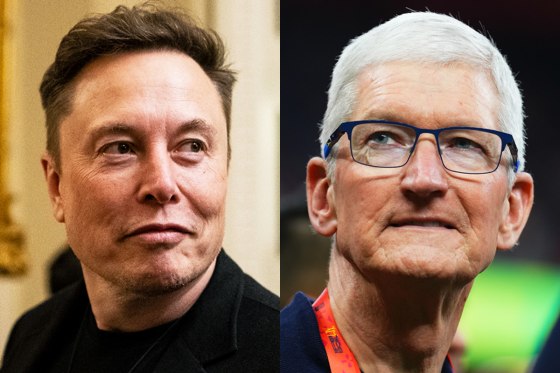

애플이 xAI의 AI 챗봇 앱 Grok에 대해 앱 스토어에서 삭제할 수 있다는 경고 서한을 보냈어요. 이유는 Grok의 이미지 생성 기능이 실존 인물의 딥페이크 이미지를 너무 쉽게 만들어낸다는 거예요. 딥페이크라는 건 AI가 실제 사람의 얼굴이나 모습을 합성해서 마치 진짜처럼 보이는 가짜 이미지나 영상을 만드는 기술인데요, 이게 악용되면 명예훼손이나 사기 같은 심각한 문제로 이어질 수 있거든요.

애플이 이렇게 직접적으로 AI 앱에 경고장을 날린 건 꽤 의미 있는 사건이에요. 그동안 앱 스토어 심사가 까다롭기로 유명했지만, AI 생성 콘텐츠에 대해 이 정도로 강경한 입장을 공식적으로 보여준 건 이번이 사실상 처음에 가깝거든요.

핵심 내용: 애플의 경고는 어떤 내용인가

NBC 뉴스가 입수한 서한에 따르면, 애플은 Grok 앱이 앱 스토어 가이드라인을 위반하고 있다고 지적했어요. 구체적으로는 "부적절하거나 유해한 콘텐츠를 생성할 수 있는 기능"에 대한 적절한 안전장치가 없다는 거예요.

Grok은 일론 머스크의 xAI가 만든 AI 챗봇인데요, X(구 트위터) 플랫폼에 통합되어 있고 독립 앱으로도 제공되고 있어요. 문제가 된 건 Grok의 이미지 생성 기능이에요. 사용자가 유명인이나 정치인 등 실존 인물의 이미지를 생성하려고 할 때 충분한 필터링이 이루어지지 않아서, 사실상 누구의 딥페이크든 쉽게 만들 수 있는 상태였던 거죠.

이게 뭐가 문제냐면, 대부분의 다른 AI 이미지 생성 서비스들 — OpenAI의 DALL-E나 구글의 Imagen 같은 — 은 실존 인물의 이미지 생성을 상당히 엄격하게 제한하고 있거든요. "버락 오바마가 해변에서 서핑하는 사진"같은 프롬프트를 넣으면 거부하거나, 최소한 실제 인물과 구별 가능한 수준으로 결과물을 조정해요. 그런데 Grok은 이런 안전장치가 상대적으로 느슨해서 문제가 반복적으로 불거져 왔어요.

애플의 앱 스토어 리뷰 가이드라인 1.1조는 "비방적이거나 모욕적인 콘텐츠"를 금지하고 있고, 5.6조는 "사용자 생성 콘텐츠를 포함하는 앱"에 대해 부적절한 콘텐츠를 필터링하는 메커니즘을 갖출 것을 요구하고 있어요. 애플은 이 조항들을 근거로 Grok에 시정을 요구한 것으로 보여요.

업계 맥락: AI 콘텐츠 규제의 판도가 바뀌고 있다

이번 사건은 단독으로 볼 게 아니라 전체적인 AI 규제 흐름 속에서 봐야 해요. 지금 AI 생성 콘텐츠에 대한 플랫폼들의 태도가 급격하게 변하고 있거든요.

구글 플레이 스토어도 2025년부터 AI 생성 콘텐츠에 대한 가이드라인을 강화했고, EU의 AI Act는 딥페이크에 대해 명시적인 라벨링 의무를 부과하고 있어요. 한국에서도 2024년에 딥페이크 처벌법이 강화되면서, AI로 만든 허위 영상이나 이미지에 대한 법적 제재가 한층 강해졌죠.

흥미로운 건 애플의 포지셔닝이에요. 애플은 자체 AI 기능인 Apple Intelligence를 출시하면서도 이미지 생성 쪽에서는 의도적으로 보수적인 접근을 취하고 있어요. 실존 인물 이미지 생성은 아예 지원하지 않는 방향이죠. 그러면서 동시에 경쟁사의 AI 앱에는 높은 안전 기준을 요구하는 건데, 이게 순수한 사용자 보호 목적인지 아니면 경쟁 전략의 일부인지는 해석이 갈릴 수 있어요.

메타의 경우도 비슷한 상황을 겪었어요. 메타의 AI 스티커 기능이 출시 초기에 부적절한 이미지를 생성해서 논란이 됐는데, 그때 메타는 빠르게 필터를 강화해서 대응했죠. 이런 "출시 후 문제 발생 → 긴급 패치" 패턴이 AI 서비스 업계에서 반복되고 있는데, 앱 스토어 플랫폼이 이런 패턴을 더 이상 용인하지 않겠다는 신호로 읽을 수 있어요.

한국 개발자에게 주는 시사점

이 사건이 한국에서 AI 서비스를 개발하는 분들에게 꽤 중요한 이유가 있어요.

첫째, 앱 스토어 배포를 고려한 AI 안전 설계가 필수가 됐어요. 만약 여러분이 AI 이미지 생성이나 텍스트 생성 기능을 포함한 앱을 만들고 있다면, 개발 초기 단계부터 콘텐츠 필터링 시스템을 설계해야 해요. 나중에 붙이면 된다는 생각은 이제 통하지 않아요. 앱이 스토어에서 내려가면 비즈니스 자체가 위험해지니까요.

둘째, 한국의 딥페이크 규제 환경도 점점 강화되고 있어요. 성적 딥페이크뿐만 아니라 일반적인 허위 이미지 생성에 대해서도 법적 리스크가 커지고 있는 상황이에요. AI 서비스를 기획할 때 법무 검토를 반드시 거치는 게 좋아요.

셋째, 이건 기술적으로도 재미있는 문제예요. 실존 인물을 감지하고 필터링하는 기술 자체가 하나의 엔지니어링 챌린지거든요. 얼굴 인식 모델과 생성 모델 사이의 파이프라인을 어떻게 설계할지, 필터링의 임계값을 어디에 둘지 같은 문제는 기술적으로 깊이 파고들 만한 주제예요.

정리

애플이 Grok에 보낸 경고는 단순한 한 앱의 문제가 아니라, AI 생성 콘텐츠에 대한 플랫폼 게이트키퍼의 역할이 본격적으로 강화되고 있다는 신호예요. AI 앱을 만들고 있다면, "우리 앱이 앱 스토어 가이드라인을 충족하는가?"를 체크리스트에 올려둬야 할 때입니다.

여러분은 AI 이미지 생성에서 실존 인물 필터링, 어디까지 제한해야 한다고 보시나요? 완전 차단? 아니면 워터마크나 라벨링으로 충분할까요?

🔗 출처: Hacker News

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공